Dark patterns

Alors que les designs trompeurs sont de plus en plus portés à l’attention du public, la question de leur possible régulation se pose, bien qu’il ne soit pas simple de démontrer le caractère fondamentalement manipulateur d’un élément composant une interface.

Le côté sombre

On ne saurait passer à côté des dark patterns ou designs manipulateurs : des éléments et mécanismes mis en place dans les interfaces pour influencer les décisions des utilisateurs dans un sens qu’ils ne choisiraient pas nécessairement s’ils étaient en face d’une interface loyale et transparente.

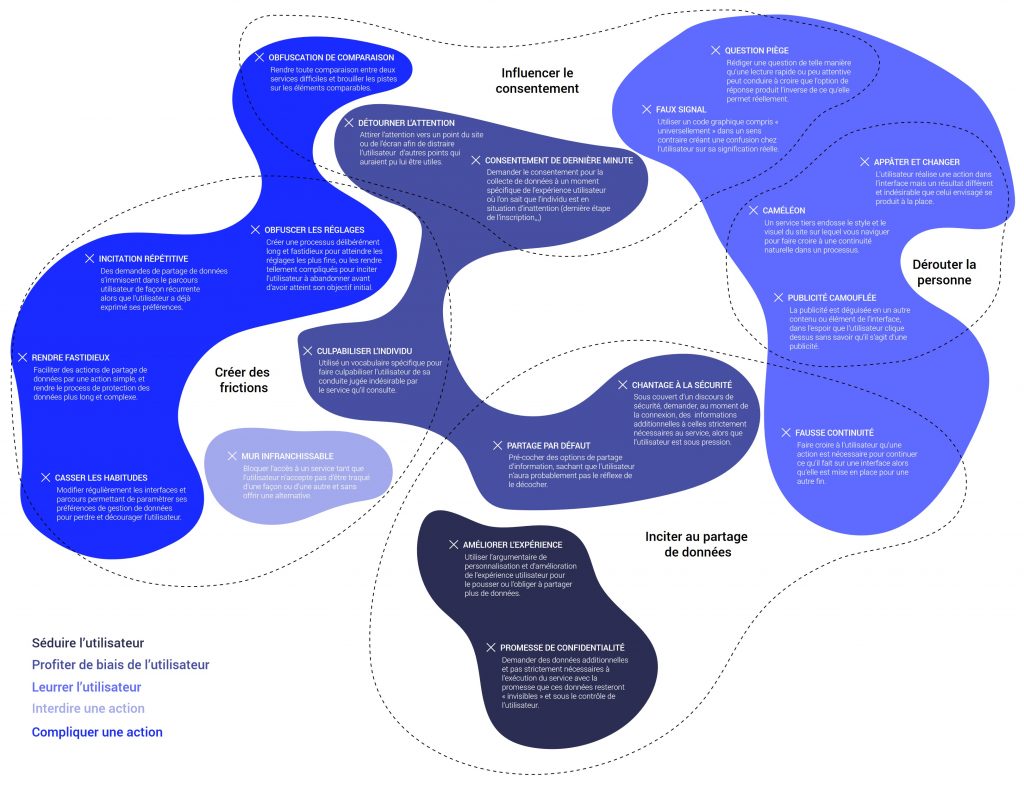

La manipulation des individus est récurrente sur les services et produits numériques, notamment au moment de la collecte des données personnelles. Souvent, ces pratiques reposent sur des designs trompeurs (dark patterns), visant à influencer le consentement, dérouter l’individu, créer des frictions d’usage ou encore à pousser l’individu à partager plus de données que nécessaire.

Ces observations sont résumées dans le visuel ci-dessous :

Un héritage de la société de consommation

La question des designs trompeurs n’est pas exclusive à la protection des données et de la vie privée. En effet, ces pratiques viennent initialement du monde publicitaire, qui les a mis en place pour convaincre les individus de consommer davantage. L’arrivée du net a permis d’adapter ces pratiques à un nouveau medium, les renforçant et les massifiant au passage. Et c’est là, que quelques manipulateurs égocentriques, comme l’on peut en rencontrer, parfois, dans divers domaines, se sont dit que se serait, sans doute, une idée géniale, qu’ils se devaient d’exploiter pour le bien de tous, bien sûr ! Dans le domaine de la protection et des droits des consommateurs, la question des pratiques déloyales est déjà prise en compte dans diverses législations, notamment dans la Directive relative aux pratiques commerciales déloyales des entreprises vis-à-vis des consommateurs (2005/29/CE) en Europe ou dans le 15 U.S.C Code § 45 – Unfair methods of competition unlawful; prevention by Commission aux Etats-Unis.

La directive Européenne s’intéresse en particulier à la relation entre l’entreprise et ses consommateurs. Elle interdit l’utilisation de pratiques commerciales déloyales impactant considérablement le comportement économique d’un individu. Ces pratiques comprennent, entre autres, celles donnant des informations fausses, pouvant donc être considérées comme mensongères ou bien omettant sciemment d’informer les consommateurs sur des caractéristiques du produit (et, bizarrement, en fonction des convictions politiques de l’environnement dans lequel on évolue, l’appréhension de la notion risque d’être très différente).

La loi étasunienne encadre quant à elle les pratiques commerciales déloyales au niveau de l’ensemble du marché intérieur. Étroitement liée à la loi antitrust, elle vise à interdire toute pratique ayant un impact important sur la concurrence et pouvant mener à un monopole. Cette logique vise en conséquence, des pratiques influençant massivement les comportements des consommateurs américains au point de les pousser à consommer seulement un produit.

Dans le cadre de la protection des données, l’utilisation de designs manipulateurs par les acteurs du numérique pose tout d’abord la question de la loyauté du service vis-à-vis de ses utilisateurs. Elle questionne également la validité du recueil du consentement : peut-on considérer un consentement comme libre, spécifique, éclairé et univoque, lorsque celui-ci a été recueilli en ayant recours à un design potentiellement abusif ou trompeur ? En effet, l’usage de tels procédés pourrait considérer que le design abusif ou trompeur des services numériques peut engendrer divers troubles au consentement, d’une nature suffisamment objective et démontrable pour qu’il entraine son invalidité. Et là aussi, bizarrement, cela pourrait très bien convenir à la description de quelques sites dans divers domaines…

La qualification de ces designs et pratiques pose cependant une question de taille : quand peut-on considérer un design comme réellement manipulateur ? Quelle est la ligne entre une persuasion « acceptable » et de la manipulation pure ? Quels sont les éléments permettant de démontrer le caractère manipulateur d’un design ?

Ces questionnements sont d’autant plus d’actualité qu’aux États-Unis, le sénateur Mark R. Warner a déposé en avril 2019 une proposition de loi dénommée DETOUR Act, visant en particulier les grandes plateformes du web, afin de réguler les pratiques d’A/B testing, interdire les design manipulateurs cherchant à induire des usages compulsifs du service ou produit, notamment chez les moins de 13 ans.

Une première typologie des dark patterns

Des pistes de réponses peuvent se trouver dans une récente étude de l’université de Princeton sur les dark patterns, même si cette étude s’est focalisée sur les sites d’e-commerce. En particulier, cette étude fournit une méthode, des outils et une base de connaissances afin d’identifier des familles de dark patterns, ainsi qu’une grille d’analyse des designs manipulateurs, en isolant par exemple les moyens mis en œuvre pour les implémenter (comme cacher des informations) ou encore l’effet attendu sur la personne.

L’étude a analysé de façon programmatique 53 000 pages d’environ 11 000 sites d’e-commerce ce qui a permis de recenser 1 841 cas d’utilisation de dark patterns, réparties en 15 types et 7 catégories. Ces pratiques chercheraient à frustrer, manipuler, offusquer ou contraindre l’utilisateur, lui causant de potentielles pertes financières, l’entraînant à partager plus de données que nécessaire ou en créant des comportements compulsifs ou addictifs. Les patterns ainsi observés ont été catégorisés de la sorte :

- Duper l’utilisateur (sneaking) : des patterns cherchant à donner une fausse représentation de l’action de l’utilisateur, à cacher ou retarder l’affichage d’une information à laquelle l’utilisateur s’opposerait si elle lui était amenée de façon transparente ;

- Instaurer un sentiment d’urgence (urgency) : des patterns imposant une date butoir pour une vente ou une promotion afin de créer un sentiment d’urgence chez l’utilisateur et accélérer sa prise de décision et son passage à l’achat ;

- Détourner l’attention / mal indiquer (misdirection) : des patterns s’appuyant sur l’utilisation de visuels, d’éléments de langages ou de réactions émotionnelles pour pousser les utilisateurs vers un choix plutôt qu’un autre ;

- Exercer une pression sociale (social proof ): des patterns s’appuyant sur la tendance conformiste des individus pour accélérer la prise de décision et le passage à l’achat ;

- Donner une impression de rareté (scarcity) : des patterns signalant la quantité limitée ou la demande forte d’un produit afin d’augmenter sa valeur et désirabilité perçue ;

- Obstruer (obstruction) : des patterns visant à rendre certaines la réalisation de certaines actions plus difficiles que nécessaire dans le but de décourager l’utilisateur de les mener à bien ;

- Forcer une action (forced action) : des patterns forçant l’utilisateur à réaliser une action additionnelle afin de pouvoir terminer la tâche initialement entreprise.

De la protection du consommateur à la protection de ses données personnelles

En comparant ces catégories définies par l’étude de Princeton, dans le contexte de la vente en ligne, à celles définies dans le contexte de la protection des données, des similarités et différences notables sont observables. Tout d’abord, les dark patterns reposant sur des logiques coercitives sont partagés dans les deux cas afin de décourager, voire empêcher, l’utilisateur de réaliser certaines actions qui iraient à l’encontre direct des intérêts économiques du service, comme, par exemple, fermer un abonnement ou régler ses paramètres de vie privée. Les techniques reposant sur le FOMO (fear of missing out ou peur de rater quelque chose) sont également partagées, se retrouvant majoritairement dans les catégories d’urgence, de pression sociale et de rareté. À noter que dans le domaine numérique, ces pratiques visent en particulier à capturer l’attention des utilisateurs afin de leur faire utiliser le plus possible un service, et par conséquent générer des données. Une autre tactique, celle de la « séduction » de l’utilisateur, est aussi mis en œuvre par ces services pour encourager au partage de données. Ils peuvent lui présenter les avantages à condition qu’il partage ses données, par exemple pour améliorer son expérience d’usage avec la personnalisation des contenus, ou lui promettre une confidentialité totale sur le partage (« ça reste entre nous »), qui est notamment utilisé sur les réseaux sociaux pour compléter un profil.

La préférence pour certaines tactiques peut s’expliquer par la différence de perception par la personne entre le partage de données et l’achat d’un produit ou service. L’investissement (financier/monétaire) ressenti n’est pas de même nature et amène les individus à prendre des décisions en fonction de mécanismes différents, même si l’objectif final est, de façon générale, d’obtenir la meilleure offre. Dans le cas du partage de ses données personnelles, la personne n’y voit aucune transaction monétaire, cela est donc apparemment gratuit de son point de vue. La promesse de meilleures fonctionnalités, c’est-à-dire une meilleure valeur d’usage, en échange de ses données lui paraît être une très bonne affaire. Cela explique l’utilisation de tactiques de séduction auprès de l’utilisateur pour le convaincre de partager ses données, alors que celles-ci ne sont pas toujours, strictement, nécessaires à la fourniture d’un service.

Une tactique de séduction appliquée à l’achat d’un produit se traduira plus par un prix bas que par la qualité du produit ou la promesse de fonctionnalités additionnelles, ce qui la rendrait moins efficace pour pousser l’acte d’achat. Dans le cas de l’achat d’un produit ou service, la personne y voit un investissement financier et aura tendance à minimiser ses dépenses ou favoriser les bons plans. L’utilisation de dark patterns instaurant un sentiment d’urgence ou une impression de rareté va accélérer le processus de décision d’achat de la personne pour l’empêcher de « trop » réfléchir au prix qu’elle va payer et les conséquences sur le long-terme de son achat. Les tactiques d’urgence ou de rareté pour inciter au partage d’information ne sont pas nécessairement efficaces, car les services liés sont, par essence, immatériels et infinis, et ne se prêtent donc pas à ce type d’approche incitative.

Si ces typologies restent exploratoires, décrire et analyser les designs manipulateurs existants est un premier pas pour penser une régulation de ces pratiques. Il est également nécessaire de prendre en considération d’autres éléments comme l’impact réel de ces dark patterns sur les personnes et leurs libertés.

Article, très largement, inspiré par celui d’Estelle HARY (Dark patterns : quelle grille de lecture pour les réguler ? – CNIL).